人工智能时代的基石 数据存储的演进与基础软件开发新范式

在人工智能浪潮席卷全球的今天,作为其核心燃料的数据正以前所未有的速度增长。数据存储技术不再仅仅是信息的“仓库”,而是演变为驱动AI模型训练、推理和进化的“智能引擎”。与此人工智能基础软件的开发也正经历着一场深刻的范式转变。

一、数据存储的智能进化:从静态仓库到动态引擎

传统的存储系统以可靠性、容量和I/O速度为衡量标准。在AI时代,数据存储的需求发生了根本性转变:

- 性能的极致追求:AI训练,尤其是大模型训练,涉及海量数据的频繁、高速读取。这催生了高性能存储架构的兴起,如全闪存阵列、计算存储分离架构,以及通过NVMe协议和RDMA网络技术实现超低延迟、超高带宽的数据访问。存储不再是系统瓶颈,而成为算力释放的加速器。

- 数据类型的融合与统一:AI处理的数据类型空前多样,包括结构化数据、非结构化文本、图像、视频、点云、时序数据等。对象存储因其出色的可扩展性和对非结构化数据的天然友好性,成为AI数据湖的主流底座。支持多协议访问(如文件、对象、块)的统一存储平台,正简化数据管理,让数据在不同AI工作流间无缝流动。

- 存储与计算的深度融合:“存算一体”成为重要趋势。通过在存储设备内部或近端集成计算能力(如智能网卡、DPU、计算型存储驱动器),可以在数据存放位置就近执行数据预处理、过滤、标注甚至初步的模型推理,大幅减少数据搬移的开销和延迟,提升整体效率。这就是“将计算带给数据”。

- 数据全生命周期的智能管理:AI工作流中的数据价值随时间变化。热数据(正在训练)需要极致性能;温数据(用于调优、推理)需要良好性价比;冷数据(归档、合规)需要低成本。智能分层存储系统能自动感知数据访问模式,在性能层、容量层和归档层之间动态迁移数据,实现成本与效率的最优平衡。

- 数据治理与安全的基石作用:高质量、合规的数据是可信AI的保障。现代存储系统正深度集成数据血缘追踪、质量管控、隐私保护(如差分隐私、同态加密支持)和权限精细化管理功能,确保用于AI训练的数据可信、可解释、可审计。

二、人工智能基础软件开发的范式转移

随着存储等基础设施的智能化演进,AI基础软件的开发方式也在同步进化:

- 以数据为中心的设计哲学:传统软件以代码逻辑为核心,而AI基础软件(如训练框架、数据平台、特征平台)则转向以“数据流”为核心进行设计。开发重点从编写复杂算法代码,转变为构建高效、可靠、可复现的数据流水线,包括数据获取、清洗、标注、版本管理、特征提取与服务的全流程工具链。

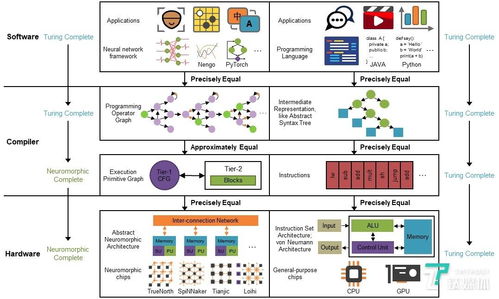

- 云原生与异构计算成为标配:AI基础软件普遍采用微服务、容器化部署,以实现弹性伸缩和高可用性。必须能灵活调度和高效利用CPU、GPU、NPU等多种异构计算资源,以及与之匹配的存储资源。Kubernetes等编排平台成为管理这些复杂工作负载的事实标准。

- 大规模分布式训练框架的成熟:为应对千亿、万亿参数模型的训练需求,基础软件如PyTorch、TensorFlow等已深度集成分布式训练能力(如数据并行、模型并行、流水线并行),并需要与底层高速存储和网络紧密协同,以保障大规模集群训练的稳定性和扩展性。

- MLOps的工程化实践:AI模型的生命周期管理(开发、训练、部署、监控、迭代)需要系统的工程方法。MLOps工具链(如MLflow、Kubeflow)的兴起,将DevOps理念引入AI领域,强调自动化、可重复性和协作,其背后离不开稳定、版本化的数据存储和模型存储的支持。

- 开源与生态共建:AI基础软件的创新高度依赖开源社区。从底层计算库(如CUDA, oneAPI)、编译器到上层框架和工具,开源协作加速了技术进步和标准形成。开发者不再是从零开始,而是在强大的开源生态基础上进行创新和集成。

人工智能时代,数据存储的进化与基础软件的开发已形成紧密的共生关系。智能化的存储系统为AI提供了高性能、高效率和可信赖的数据基石;而新一代以数据为中心、云原生、支持大规模分布式训练的AI基础软件,则最大化地挖掘了这座数据金矿的价值。随着存算一体、量子计算等前沿技术的发展,两者还将继续协同进化,共同构筑起更加坚实、智能和普惠的人工智能基础设施,推动智能技术迈向新的高峰。

如若转载,请注明出处:http://www.hongxinxinxikeji.com/product/91.html

更新时间:2026-04-16 23:17:11